La “révolution IA” est partout. L’intelligence artificielle s’installe de plus en plus dans nos outils, dans nos discussions, dans nos vies. Cette technologie apporte un lot de nouveaux usages jusqu’ici impensables il y a une dizaine d’années. On peut aussi bien générer de la poésie à la manière de Leopardi que de construire un film d’auteur par la simple force de ses doigts sur un clavier. On peut même y découvrir un petit ami fidèle, disponible et riche de connaissances derrière ce simple courant électrique informatisé.

Néanmoins, si les apports de cette technologie ne sont plus à prouver, une part plus sombre reste présente. Ce revers de la médaille, perçu souvent à tort comme un courant techno-pessimiste, amène un lot de questions importantes auxquelles nous n’avons pas encore répondu. Et ce sont ces réponses, tantôt techniques, tantôt morales, qui compliqueront ou non la démocratisation de l’IA.

Le but de cet article n’est pas d’être inutilement pessimiste mais de construire un inventaire des problèmes auxquels nous (en tant que société) devons répondre pour poursuivre efficacement cette révolution de l’IA. Afin de rendre cet inventaire plus accessible, chaque problème est représenté par une question sans réponse. La réflexion de chaque question est argumentée après ladite question. Des médias d’ouverture sont aussi proposés pour chaque problème, si vous souhaitez creuser plus loin sur l’un d’entre eux.

Il est important de noter que cet article ne propose pas de solutions. La grandeur des domaines traités implique une expertise sur chacun desdits domaines afin de pouvoir prétendre apporter une solution. Faute d’expertise polymathe, cet article suit un axe documentaire. Des angles morts pouvant toujours subsister dans ces réflexions, cet inventaire n’est pas exhaustif.

Les problèmes écologiques et énergétiques

Problème 1

Comment éviter que l’IA participe activement à une future crise de l’eau ?

En 2019, Google avait construit des data-centers supplémentaires en Arizona, ce qui conduisit à un article du Time insistant lourdement sur le fait que ces data-centers consommaient beaucoup trop d’eau dans des zones déjà affectées par la sécheresse. L’Arizona étant déjà l’une des principales victimes, l’État s’était retrouvé dans des combats politiques pour essayer de continuer à pouvoir fournir de l’eau aux habitants.

Cette crise de l’eau ne s’est absolument pas améliorée avec le temps comme on a pu le constater avec les récentes sécheresses. Et, en parallèle, l’IA augmente la nécessité d’avoir plus de datacenters, donc encore et toujours plus d’eau à disposition. Mis en corrélation avec les prévisions du GIEC concernant des sécheresses beaucoup plus courantes, le futur s’oriente vers une guerre de l’eau afin de définir qui des habitant-es ou des machines doivent être hydratés.

Problème 2

Comment concilier la consommation énergétique des data centers et la crise écologique ?

L’IA nécessite beaucoup de processeurs graphiques pour être entraînée et pour fonctionner. La demande en énergie a donc grimpé d’une manière peu conventionnelle. Si bien que les centrales à charbon ont été rouvertes pour essayer de sauver les américain-es des coupures électriques. De multiples plans d’investissement ont donc été décidés afin de fournir plus d’énergie et sauver les data-centers. Sauf que ces plans prennent des années pour être achevés, laissant donc la part belle à une consommation d’énergies fossiles largement accrue pendant ce temps.

Beaucoup moins loin de nous, et après que le gouvernement nous invitait à la sobriété énergétique pour éviter les coupures pendant l’hiver (devenu maintenant un levier écologique pour sauver l’environnement), l’Alsace est maintenant en négociation pour accueillir un data center de Microsoft dont la consommation énergétique a été estimée équivalente à celle de 350 000 foyers. Pendant ce temps, les Hauts-de-France souhaitent devenir une zone reconnue sur l’IA et l’Île-de-france va accueillir son lot de datacenters, le tout sous couvert d’une réduction fiscale sur l’électricité. Comble de l’inquiétude, les investissements liés au climat ont baissé de 5 % entre 2023 et 2024. De fait, on assiste à une protection des entreprises d’IA afin que la France devienne une puissance dans ce domaine, au détriment d’efforts accrus sur l’écologie.

Pour aller plus loin sur ces problèmes :

- [EN] We did the math on AI’s energy footprint. Here’s the story you haven’t heard. — J. O’Donnell, C. Crownhart — MIT Technology Review — 20 mai 2025

- [FR] Les impacts de l’IA sur l’environnement — F. Garcia, S. Schbath — Annales des Mines — Mars 2025

- [EN] The Uneven Distribution of AI’s Environmental Impacts — S. Ren, A. Wierman — Harvard Business Review— 15 Juillet 2024

Le problème financier

Problème 3

Comment créer une économie de l’IA stable et indépendante des investissements financiers ?

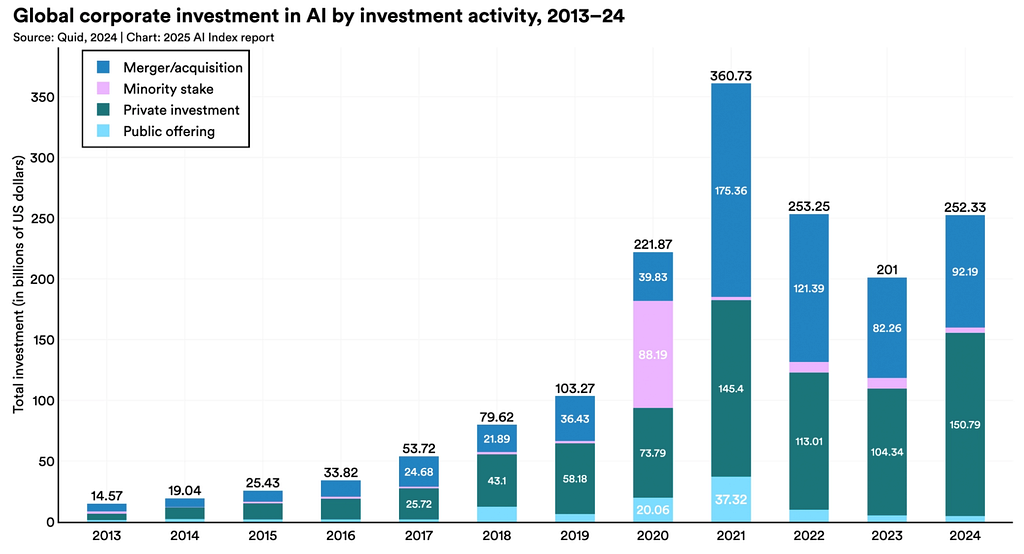

D’après le graphique (G1), l’IA se caractérise par des financements élevés à hauteur de 250 milliards de dollars en 2024. La première information intéressante est que cette valeur traduit un attrait du domaine pour les investisseurs et les investisseuses, mais aussi une quantité croissante d’argent nécessaire afin de développer des modèles de plus en plus puissants, si bien que l’on prévoit des entraînements à un coût de plus de 1 milliard d’euros pour 2027.

La deuxième information que l’on peut extraire de ce graphique est la tendance des investissements au cours des dernières années. En considérant que 2021 est une année exceptionnelle en termes de financement, les investissements dans l’IA sont stables à hauteur de 250 milliards de dollars depuis 2021. À l’inverse, les investissements dans la Cleantech ont mondialement diminué depuis 2021, passant de 51,7 milliards d’euros à 31,8 milliards d’euros en 2024. Et, de manière plus générale, le secteur de l’IA draine une très grande partie des investissements au détriment des autres secteurs. Pendant le 1er trimestre de 2025 aux Etats-Unis, les investissements dans l’IA ont représenté 71 % des investissements totaux. Pendant ce temps, en France, le Président de la République annonce une enveloppe de 109 milliards d’euros d’investissement dans l’IA financée majoritairement par les Émirats arabes unis.

En parallèle, plusieurs articles de Bloomberg ont mis un coup de projecteur sur les financements circulaires qui composent en grande partie l’IA d’un point de vue financier, mettant à nouveau l’accent sur l’existence d’une bulle IA (graphique G2). Même Sam Altman, le CEO d’OpenAI, parle de cette bulle d’investissement dont l’explosion va mettre à mal l’économie américaine. Face à ces risques, les investisseurs et les investisseuses commencent déjà à revoir leurs stratégies afin d’éviter de vivre une explosion de la bulle Dotcom 2.0.

Pour aller plus loin sur ce problème :

- [EN] The 2025 AI Index Report: Chapter 4: Economy— HAI Stanford University — Avril 2025

- [EN] The real (economic) AI apocalypse is nigh — C. Doctorow —Pluralistic — 27 Septembre 2025

- [EN] 3 reasons everyone is talking about an AI bubble — A. Tecotzky — Business Insider — 26 Août 2025

Les problèmes liés au travail

Problème 4

Comment augmenter la productivité via l’IA sans diminuer le bien-être des travailleurs et travailleuses ?

Probablement l’impact le plus attendu par les investisseurs et les investisseuses, “l’intelligence artificielle […] possède le potentiel d’être aussi innovante que le moteur à vapeur l’a été pendant la révolution industrielle du 19ème siècle”, selon un article de McKinsey citant une étude de McKinsey. Théoriquement, l’IA est une technologie qui pourrait révolutionner notre façon de travailler et devenir un outil magique pour nous aider sur divers problèmes. Ses capacités en font un assistant parfait pour construire des notes de réunion ou retrouver des informations disséminées dans un ensemble de documents. Cependant, dans la pratique à court terme, ces améliorations ont des résultats mitigés.

En termes de productivité, on retrouve autant de cas positifs que de cas négatifs. À court terme, il est donc difficile de qualifier l’impact de l’IA sur le quotidien des employé-es, et il est nécessaire d’attendre des études plus larges afin d’avoir cette réponse. Néanmoins, un article a déjà permis d’éclairer la pratique du AI workslop, c’est-à-dire des documents de travail qui ont l’air d’être correctement faits mais dont le contenu est en réalité totalement bâclé. Cette pratique diminue donc purement et simplement la productivité des groupes de travail.

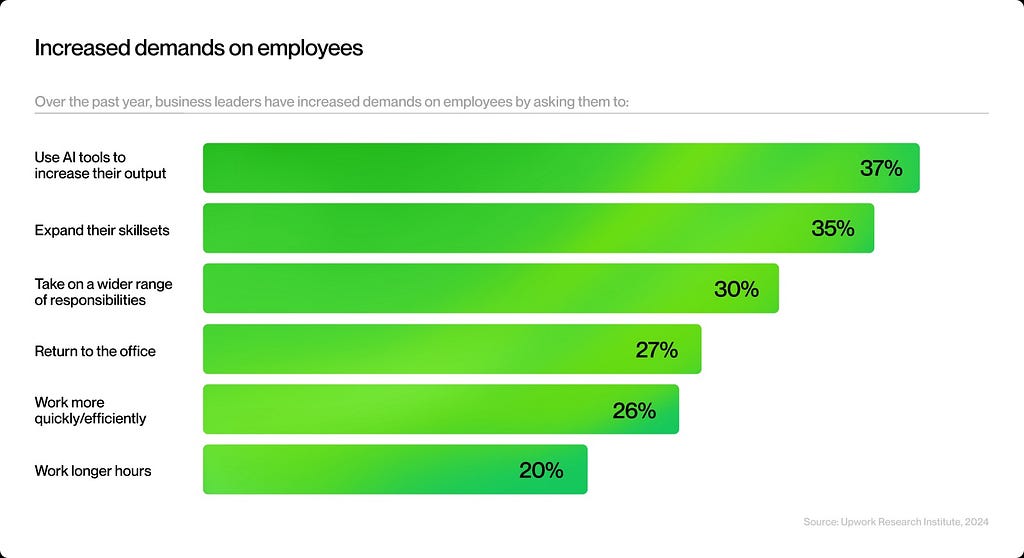

Sur le plan du bien-être au travail pour les employé-es, on constate aussi bien des conditions de travail inchangées dans le cas d’entreprises allemandes que des conditions dégradées dans le cas d’entreprises anglophones (d’après le graphique G3). Une explication de cette différence pourrait être l’écart entre la sécurité de l’emploi beaucoup plus forte pour les entreprises allemandes par rapport aux entreprises anglophones, inhibant la nécessité d’une productivité largement accrue pour conserver son emploi. Par conséquent, l’intégration de l’IA dans les milieux de travail nécessiterait une législation du travail forte et un environnement de travail sain afin d’éviter l’augmentation du nombre de burn-outs.

Pour aller plus loin sur ce problème :

- [EN] Artificial intelligence and the wellbeing of workers— O. Giuntella, J. Konig, L. Stella — Nature — 23 Juin 2025

- [EN] Does AI actually boost productivity? The evidence is murky — J. Whittle — The Conversation — 10 Juillet 2025

Problème 5

Comment permettre aux travailleurs et travailleuses des métiers détruits par l’IA de vivre ?

La peur de la perte de l’emploi causée par l’avènement de l’IA n’est absolument pas une illusion. Amazon, UPS, HP, Cisco, Duolingo ou encore Klarna sont des exemples de licenciements massifs spécifiquement attribués à l’IA. Ces exemples, dans un secteur de la tech qui a déjà été très touché ces dernières années par les vagues de licenciements, ne font que rajouter à l’angoisse permanente que partagent les travailleurs et travailleuses de la tech.

Il faut cependant considérer que ces exemples sont liés à des entreprises anglo-saxonnes avec, comme expliqué dans le problème précédent, une sécurité de l’emploi plus faible. En se penchant sur le contexte français, le cas de licenciement au profit de l’IA le plus connu est celui de Onclusive. L’entreprise aurait licencié 217 personnes sous le motif de l’IA, mais ce motif est contesté. De plus, une décision du tribunal judiciaire de Nanterre du 14 février 2025 semble donner une première direction de la mise en place de l’IA dans les entreprises en faveur de la sécurité des emplois. Néanmoins, il est nécessaire d’attendre une première jurisprudence de la Cour de Cassation afin de définitivement confirmer cette direction.

En dehors de la tech, cette angoisse permanente est aussi présente. Les travailleurs et travailleuses dans des domaines comme le graphisme, la traduction, le son, la photographie, i.e. de métiers créatifs, sont aujourd’hui très largement affectés par une baisse de leurs revenus. Et la raison est simple : pourquoi payer une personne 100 € afin d’obtenir une image faite main alors qu’un abonnement à ChatGPT est trois fois moins cher et permet d’obtenir autant d’images que l’on veut ? En appliquant ce raisonnement à la musique, on obtient donc une crise sur un marché déjà très fragilisé par l’avènement des plateformes de diffusion musicale.

L’unique moyen pour contrer les effets néfastes de cette destruction progressive des emplois est “simple” : il est nécessaire de repenser le fonctionnement de notre société. Sans emploi, les gens ne peuvent pas gagner d’argent. Et sans argent, les gens ne peuvent pas vivre. Notre modèle de société actuel n’est donc pas compatible avec les conséquences de l’IA sur les domaines créatifs, et ces conséquences vont continuer inlassablement à empirer.

Pour aller plus loin sur ce problème :

- [EN] AI Slop is destroying the Internet — Kurzgesagt — In a Nutshell — Youtube — Octobre 2025

- [EN] The Simple Macroeconomics of AI — D. Acemoglu — MIT — 5 Avril 2024

- [FR] Vers une nouvelle conception du travail ? — F. Kauder —aamulumi.info — 2 Octobre 2019

Problème 6

Comment continuer à former des personnes expérimentées face à la diminution des postes de juniors ?

En considérant les métiers qui sont affectés directement par l’IA, il y a un déclin net du nombre de recrutements sur des personnes en début de carrière. Ce déclin est également absent chez les travailleurs et travailleuses plus expérimentés. Or, si ce déclin peut paraître comme une tendance temporaire à court terme, il est important de garder en tête que sans débutants et débutantes, il n’y a pas d’experts et d’expertes.

Il est très facile d’illustrer les conséquences d’un manque de formation par une chose que nous connaissons bien en France : le manque de médecins. La politique du numerus clausus a limité le nombre de personnes formées à la médecine entre 1970 et 2020. De fait, la population grandissante et la densité médicale faiblissant, ce manque de formation des débutants et débutantes a créé une situation médicale très tendue. Ce type de scénario existe déjà dans l’informatique avec une pénurie de spécialistes du COBOL créant un climat alarmant pour le secteur bancaire. Et, faute de continuer à former des personnes, la “cobol-isation” des métiers pourrait s’étendre.

Pour aller plus loin sur ce problème :

- [EN] The Perils of Using AI to Replace Entry-Level Jobs — A. C. Edmondson, T. Chamorro-Premuzic — Harvard Business Review — 16 Septembre 2025

- [EN] Canaries in the Coal Mine? Six Facts about the Recent Employment Effect of Artificial Intelligence — E. Brynjolfsson, B. Chandar, R. Chen — HAI Stanford University — Novembre 2025

- [EN] New evidence strongly suggests AI is killing jobs for young programmers — T. B. Lee — Understanding AI — 28 Août 2025

Les problèmes juridiques

Problème 7

Comment garantir la protection de la propriété intellectuelle face à une exploitation illégale des données pour l’entraînement des IA ?

L’entraînement des modèles des IAs se traduit par l’exploitation de médias différents, et, très généralement, de médias soumis à la propriété intellectuelle. De fait, un grand nombre de procédures judiciaires sont en cours, et, dernièrement, OpenAI a réussi à se mettre à dos une grande partie de l’industrie japonaise avec Sora 2 (et aussi le gouvernement japonais). Pour éviter ces problèmes légaux, les différentes entreprises entraînant des IAs essaient une nouvelle méthode : se servir des données de leurs utilisateurs et utilisatrices. On retrouve donc maintenant LinkedIn (Microsoft), Instagram & Facebook (Meta) et X à cette table, mais aussi Slack, Figma ou encore Tumblr.

Pour aller plus loin sur ce problème :

Problème 8

Comment faire évoluer le principe de propriété intellectuelle face à la génération d’oeuvres ?

En se basant sur le droit français (suivant l’AI Act de l’Union Européenne), la règle est simple : une création intégralement créée par une IA ne peut être soumise au droit d’auteur car l’IA n’est pas humaine. Cependant, si l’IA n’est utilisée qu’à titre d’outil, le droit d’auteur revient alors à l’auteur-e. Passé cette simplicité, une question vient alors tout remettre en cause : comment différencier une création de l’IA et une création assistée par l’IA ?

Une excellente illustration de ce problème se pose dans le fameux cas de Jason M. Allen qui avait gagné un concours d’art en 2022 avec une oeuvre générée par IA (image I2 ci-dessus). Suivant cet événement, il a décidé de faire enregistrer son oeuvre à l’U.S. Copyright Office, mais celui-ci à refusé l’enregistrement vu que celle-ci a été générée par une IA. Ce qui amène donc une réflexion morale sur un ensemble de sujets :

- si les oeuvres générées par IA sont refusées, que se passe-t-il si les oeuvres ne sont pas indiquées comme étant générées par IA ? Et, à l’inverse, est-ce que des oeuvres faites par des humain-es vont être refusées car trop proches des créations des IAs ?

- si le droit d’auteur ne peut être appliqué que pour des oeuvres créées par des humains, qu’en est-il des oeuvres construites par des algorithmes et reconnues comme celles de Vera Molnár ou de Manfred Mohr ?

- à partir de quel moment doit-on considérer qu’une oeuvre est créée par assistance de l’IA ou est créée par l’IA ? Est-ce que l’application d’un simple filtre de couleur par un-e humain-e rend l’oeuvre humaine ?

De telles questions ne sont que difficilement solvables sans outils de détection adaptés. Et ces outils, bien qu’existants, ne sont déjà pas recommandés dans le contexte académique à cause d’un trop grand nombre d’erreurs.

Pour aller plus loin sur ce problème :

- [FR] IA générative et créations de mode : quels enjeux juridiques ? — G. Makoundou — La Grande Bibliothèque du Droit — Juillet 2024

- [EN] The AI Act Explorer — Future of Life Institute

- [EN] Can Works Created with AI Be Copyrighted? Copyright Office Issues Formal Guidance — E. Gourvitz, S. L. Ameri — Ropes&Gray — Mars 2023

Les problèmes sociaux

Problème 9

Comment éviter que l’intelligence artificielle devienne un catalyseur de propagation de fausses informations ?

Les réseaux sociaux ont un impact direct sur notre monde. Et donc propager une fausse information a de réelles conséquences. Par exemple, les campagnes marketing sur Facebook ont eu des impacts directs sur l’élection présidentielle américaine de 2016, et les théories du complot se développent dangereusement via des chambres d’écho des réseaux sociaux. En parallèle de ces évolutions, les outils de détection des fake news continuent de se développer, mais le mal est déjà fait et une partie des sociologues et politologues parlent de notre entrée dans l’ère de la post-vérité où le mensonge n’est plus odieux et la vérité n’est plus primordiale.

Dans ce contexte compliqué, il est nécessaire de bien comprendre que l’IA va avoir un impact important sur plusieurs aspects de la vérité. Son utilisation permet de réduire drastiquement le temps nécessaire à construire une information (rédaction, mise en page, correction, publication), qu’il s’agisse d’une information textuelle, graphique, ou même audiovisuelle. Par conséquent, des plateformes comme Youtube font face à une quantité croissante de contenus partiellement ou intégralement générés par IA. De plus, et à cause de notre incapacité à différencier des informations générées et non générées (bien que des méthodes s’affinent pour pallier à ce problème), la mésinformation prend une ampleur nouvelle depuis 2023 et l’avènement des images générées.

Pour aller plus loin sur ce problème :

- [EN] AMMEBA: A Large-Scale Survey and Dataset of Media-Based Misinformation In-The-Wild —N. Dufour, A. Pathak, P. Samangouei, N. Hariri, S. Deshetti, A. Dudfield, C. Guess, P. H. Escayola, B. Tran, M. Babakar, C. Bregler — arXiv — Mai 2024

- [EN] A Guide to Misinformation Detection Data and Evaluation — C. Thibault, J.-J. Tian, G. Peloquin-Skulski, T. L. Curtis, J. Zhou, F. Laflamme, Y. Guan, R. Rabbany, J.-F. Godbout, K. Pelrine — arXiv — Août 2025

Problème 10

Comment éviter que l’intelligence artificielle soit utilisée à des fins de violences psychologiques et morales ?

Les faits de cyberviolence sont déjà nombreux. Dans un sondage statistique fait en 2021 (image I3), 41 % des français et françaises déclaraient avoir vécu des faits de cyberviolence. Cette statistique augmente dramatiquement et systémiquement pour les personnes issues de minorités et les jeunes. L’échantillon étant insatisfaisant pour déterminer le taux de condamnations, nous pouvons estimer un ordre de grandeur de ce taux via une hypothèse : les faits de violences sexistes et sexuelles (VSS) sont considérés comme plus graves que les faits de cyberviolences. En suivant ce procédé, et en considérant que moins de 10 % des victimes de VSS portent plainte et que moins de 10 % de ces plaintes donnent lieu à une condamnation, on arrive à une valeur très faible de moins de 1 % de condamnations.

Dans ce contexte, l’intelligence artificielle a simplifié dangereusement l’accès à des outils de harcèlement. Dans une première mesure, l’IA peut être utilisée comme générateur de médias de harcèlement. Les criminels peuvent facilement construire des médias autant et même plus efficaces que les médias traditionnels. On retrouve cette utilisation en France à travers une pléthore de vidéos de gorilles à connotation raciste, destinées à harceler les personnes issues d’autres ethnies.

Dans une seconde mesure similaire, l’IA est un outil extrêmement efficace pour la création des deepfakes. Et, de cette idée, le nombre de cas de génération de contenus explicites sans consentement a explosé. Les outils de “nudification” illégaux se sont multipliés, avec des modèles économiques différents mais souvent destinés à la même clientèle : les hommes. On retrouve leur utilisation aussi bien sur des influenceuses que des femmes du quotidien. Et de mal en pis, on retrouve aussi cet usage sur les enfantes et adolescentes, aussi bien par leurs camarades que par des pédocriminels. Et, comme énoncé dans les problèmes juridiques, le manque de moyens de détection empêche la diminution du nombre de victimes.

Enfin, dans une troisième mesure, l’entraînement des modèles d’IA se fait par la création de jeux de données en labellisant notamment des milliers d’images (procédé qui, par ailleurs, exploite des millions de gens). De fait, l’IA va définir les choses de la même façon que nous les définissons. Ce qui signifie aussi retrouver les mêmes biais de stéréotypes de la société. On retrouve donc des biais racistes sur l’Australiana et sur l’African American English ou encore des biais misogynes. Il est cependant à noter que les LLMs semblent récemment évoluer dans le bon sens sur des sujets comme la transphobie (excepté Grok).

Pour aller plus loin sur ce problème :

- [EN] Analyzing the AI Nudification Application Ecosystem — C. Gibson & D. Olszewski & N. G. Brigham & A. Crowder & K. R. B. Butler & P. Traynor & E. M. Redmiles & T. Kohno — arXiv — Novembre 2024

- [EN] AI can be cyberbullying perpetrators: Investigating individuals’ perceptions and attitudes towards AI-generated cyberbullying — W. Pei, F. Wang, Y. T. Chua — ScienceDirect — Septembre 2025

- [EN] ‘Australiana’ images made by AI are racist and full of tired cliches, new study shows — T. Leaver & S. Srdarov — The Conversation — 14 Août 2025

Le problème sur la science

Problème 11

Comment éviter que l’intelligence artificielle contribue à la pollution globale dans les articles scientifiques ?

Depuis plusieurs années, le monde de la publication scientifique est frappé par la publication massive de faux articles scientifiques. Le nombre de rétractations est passé d’environ 1 000 en 2013 à plus de 10 000 en 2023. Cette augmentation est due à la corruption grandissante dans le milieu, mettant en scène des fermes à articles et des journaux de publication avides d’argent, pour permettre à certains chercheurs et chercheuses d’accéder à des promotions ou des primes ou pire, manipuler l’opinion publique en fournissant des arguments scientifiques fallacieux. Ce qui donne, par exemple, près de 10% des articles scientifiques sur le cancer qui auraient été écrits par ces fermes depuis 1999. Ou encore une très belle liste de plus de 500 articles rétractés sur le thème du COVID-19.

Face à ces chiffres alarmants, des chercheurs et chercheuses ont commencé à s’organiser pour combattre ces fausses publications. Mais l’innovation apportée par l’IA sur la rédaction de contenus divers a accéléré la tendance de publication de faux articles ou d’articles redondants, impactant particulièrement le domaine de la médecine.

Pour aller plus loin sur ce problème :

Après toute cette lecture, l’arrivée de l’IA peut sembler n’être finalement qu’une descente aux enfers de l’incertitude. Cependant, cette incertitude peut se lire de plusieurs manières : elle est l’absence d’un chemin à suivre, tout comme elle est l’existence d’une direction à créer. C’est cette direction qu’il faut définir ensemble, en tant que société humaine et non en tant qu’entreprise libérale. Cette liste de problèmes correspond à un nombre de possibilités sur lesquels nous pouvons discuter, réfléchir, argumenter, afin de construire un futur dans lequel l’IA rend raison à l’idéal de Keynes.

Il est donc de notre devoir de raisonner sur ces sujets. Nous devons comprendre ce qui n’a pas été compris, et penser ce qui n’est pas défini. De cette manière, nous pourrons concevoir un cadre sain autour de l’IA, cadre qui manque cruellement aujourd’hui et est comblé, pour le moment, par les décisions d’entreprises et d’entrepreneurs. C’est à nous de choisir comment l’IA doit nous impacter, et c’est maintenant qu’il faut commencer ce travail.

Merci à Nicolas, Julien, Olivier, Théo, Marine, Maxime et Élodie pour leur aide à la relecture et leurs conseils, et merci à ekino de m’avoir laisser le temps d’écrire cet article qui compte énormément pour moi.

Si jamais vous voulez me voir écrire plus de choses de ce type, hésitez pas à suivre le compte Medium d’ekino et ajouter un petit like ! Et prenez soin de vous !

L’IA face à ses problèmes was originally published in ekino-france on Medium, where people are continuing the conversation by highlighting and responding to this story.